¿Qué son Word EMBEDDINGS? ¡Explorando Embeddings con GloVe y Python!

Vložit

- čas přidán 25. 10. 2023

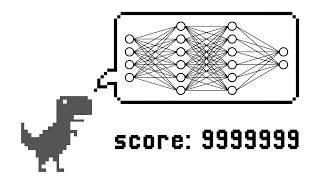

- Bienvenidos a este nuevo video en el que vamos a explorar el emocionante mundo de los "Word Embeddings" o incrustaciones de palabras. Pero no nos detendremos en la teoría; ¡Vamos a llevarlo a la práctica utilizando GloVe!

Puntos Clave:

Introducción a los "Word Embeddings" y su importancia en el Procesamiento del Lenguaje Natural (PLN) O Natural Language Processing.

Implementación de funciones Python para resolver analogías, encontrar palabras similares y visualizar mapas de palabras.

Tecnologías Utilizadas:

GloVe (Global Vectors for Word Representation) como modelo de incrustación de palabras preentrenado.

Python para la implementación de funciones de análisis y visualización.

Lo Que Aprenderás:

Cómo cargar y utilizar embeddings preentrenados con GloVe.

Cómo implementar funciones Python para responder preguntas como "hombre es a mujer como rey es a...?".

Cómo visualizar las relaciones semánticas entre palabras en un mapa.

Gracias profe!! No desistas nunca de realizar estas explicaciones de manera tan sencilla y práctica y en español. Siempre muy agradecida.

Excelente como siempre Pepe! Ojalá continúes con esta serie de NLP hasta llegar a los grandes modelos de lenguaje!! Muchas gracias!! Abrazo

Hola @matiasasses9841 , muchas gracias por tu comentario! Mi intención es en la próximas semanas, precisamente llegar a cubrir e implementar en código al menos versiones miniatura de transformers. Un abrazo!

Gracias

Muchas gracias por tu comentario!

Pepe. Quiero que siempre recomiendo tu canal. Sobre todo los chicos que entran en la carrera de Ingeniería Informática y que sienten interés por Deep Learning o Inteligencia Artificial en general. Muy buenos vídeos, me estas inspirando mucho a hacer algo parecido en un futuro.

muy claro, gracias

hay pocas explicaciones tan sencillas de entender

Muy buen video. Entender qué es un embeddings fue algo que me costó algo de trabajo asimilar, pero tu explicación me parece muy clara. Sigue así profe.

Genial!

Muchas gracias!

Excelente el video pepe, muy buena la explicación.

Que impresionante! Muchas gracias Pepe.

Como siempre Leonardo, agradezco enormemente tu apoyo al canal desde su inicio! Muchos saludos!

representar 200 dimensiones en SOLO dos dimensiones parece muy realista

Hola Pepe una consulta en la función los más similares estoy utilizando para la distancia del coseno un valor mayor 0.5 cuál sería el valor apropiado?

arriba MNA!!

Una pregunta la unidad de medida que representa la cercanía de una palabra hacia otra está dado por el universo de los datos o por otra cosa?, que hace que una palabra esté más cerca de la otra? en el fondo como se construye esta unidad de medida de la distancia?

Hicieron el paper Meta Learning for Compositionally,MLC en Nature,básicamente dicen que han encontrado una forma de modificar un Seq2Seq y crear un modelo que supera incluso a los humanos(25 que hicieron el experimento) en generalizar predicciones....Si puede explicarlo mejor aquí....😂